Pierwsze symptomy ukrytych blokad

Gdy coś blokuje indeksację lub spowalnia stronę, objawy często wyglądają podobnie. Nagły spadek widoczności w wyszukiwarce, brak nowych podstron w indeksie oraz skok czasu ładowania to typowe sygnały.

Niektóre objawy są subtelne. Na przykład problemy z renderowaniem JavaScript mogą powodować, że robot widzi mniej treści niż użytkownik. Trzeba zebrać dane zanim zacznie się działać.

Jak odróżnić objaw od przyczyny

Najpierw zbierz informacje z różnych źródeł. Porównaj raporty z Search Console, logi serwera i testy z przeglądarki w trybie incognito. Jeśli wszystkie źródła wskazują na ten sam problem, rośnie szansa że to przyczyna.

Uważaj na fałszywe korelacje. Przykładowo spadek ruchu po wdrożeniu redesignu nie musi oznaczać problemu z indeksacją. Może to być zmiana treści lub struktury linków. Diagnoza wymaga kroków weryfikacji i testów kontrolnych.

Sprawdź więcej treści z SEO techniczne.

Podstawowe narzędzia diagnostyczne

Search Console pozostaje podstawą do wykrywania problemów z indeksacją. Pokazuje zablokowane adresy, błędy indeksowania i problemy z mapą strony. Do analizy wydajności przydaje się Lighthouse oraz narzędzia do monitoringu czasu odpowiedzi serwera.

Narzędzia do crawlowania lokalnego pomogą odtworzyć zachowanie robota. Logi serwera pokażą co faktycznie żąda crawler i jakie statusy otrzymuje. Proste polecenia curl ujawnią nagłówki HTTP i X Robots Tag.

Szybkie testy do wykonania od razu

Sprawdź plik robots.txt pod kątem reguł blokujących całą stronę lub ważne ścieżki. Zbadaj meta tagi robots na kluczowych podstronach i nagłówki X Robots Tag w odpowiedziach serwera. Przeanalizuj przekierowania i upewnij się, że nie tworzą pętli.

Wykonaj test renderowania strony jako Googlebot. Jeśli treść nie pojawia się po renderze, problem może leżeć po stronie JavaScript. Jeśli widzisz błędy 5xx lub niestandardowe nagłówki, zacznij od ustawień serwera.

Sprawdź więcej treści z Problemy techniczne.

Błędy serwera i konfiguracji wpływające na indeksację i wydajność

Błędy 5xx sygnalizują problemy po stronie serwera i mogą spowodować ograniczenie crawlowania. Niestabilny hosting lub przeciążenie bazy danych prowadzi do przerywanych odpowiedzi i gorszych wskaźników wydajności.

Niekiedy nagłówki cache lub błędne reguły CDN blokują poprawne dostarczanie plików. Złe ustawienia CORS lub brak kompresji zwiększają czas ładowania. TTFB powyżej rozsądnych wartości często wskazuje na problem serwerowy.

Jeżeli strona zwraca niestandardowe odpowiedzi na żądania robotów, warto to skorygować przed działaniami optymalizacyjnymi. Stabilność serwera to fundament poprawnej indeksacji.

Konflikty skryptów i wpływ na widoczność treści

Treść ładowana wyłącznie po stronie klienta może być niewidoczna dla robotów, jeśli renderowanie się nie kończy. Asynchroniczne ładowanie i błędy JavaScript mogą ukrywać sekcje ważne dla SEO.

Lazy loading obrazów i elementów interfejsu poprawia szybkość, ale jeśli implementacja powoduje blokowanie kluczowej treści dla renderu, to może też zaszkodzić. Testy renderowania i analiza waterfall w narzędziach deweloperskich pomagają znaleźć takie konflikty.

Jak czytać logi crawlery i nie mylić efektu z przyczyną

Logi pokazują, kiedy robot odwiedził URL i jaki status otrzymał. Jeżeli widzisz wzrost 404 to może oznaczać, że linki wewnętrzne zmieniły się lub sitemap jest nieaktualna. Nie zakładaj od razu złej intencji wyszukiwarki.

Zwróć uwagę na wzorce. Powtarzające się błędy 403 na wielu URL sugerują regułę blokującą. Pojedyncze wyjątki częściej wynikają z chwilowych problemów. Dobre rozumienie logów pozwala szybko wyselekcjonować obszary do naprawy.

Sprawdź więcej treści z bazy wiedzy SEO.

Kiedy problem wymaga pilnej interwencji

Interweniuj natychmiast gdy znikają strony przynoszące ruch lub sprzedaż. Podobnie reaguj na problemy, które wpływają na indeksowanie całych kategorii albo gdy robot jest masowo blokowany.

Problemy związane z bezpieczeństwem, takie jak wstrzyknięcie złośliwego kodu, trzeba usuwać niezwłocznie. Pozostałe usterki można najpierw zdiagnozować i zaplanować naprawę krok po kroku. Priorytet ustal na podstawie wpływu na użytkownika i biznes.

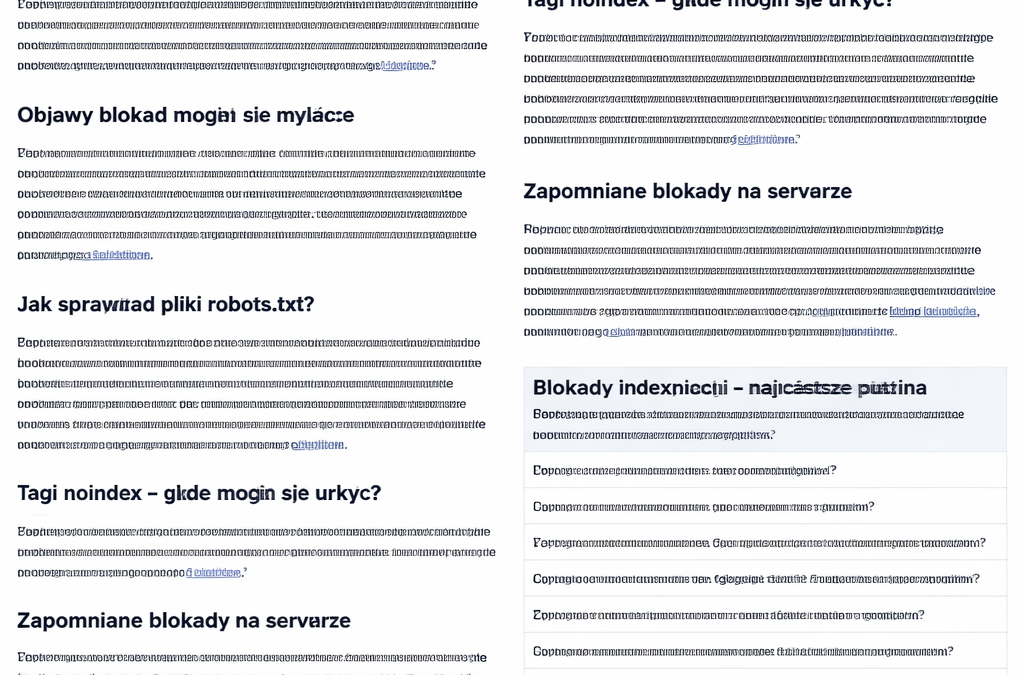

blokady indeksacji – najczęstsze pytania

W tej sekcji odpowiem na praktyczne pytania dotyczące blokad indeksacji. Odpowiedzi są krótkie i skoncentrowane na działaniu i diagnostyce.

Dlaczego część stron nie jest indeksowana?

Najczęściej przyczyną są reguły robots, meta tagi noindex, błędy servera lub brak linków wewnętrznych prowadzących do tych stron.

Czy robots.txt może spowodować spadek ruchu?

Tak, jeśli zablokuje dostęp do ważnych katalogów lub plików potrzebnych do renderowania treści, to robot nie zobaczy strony poprawnie.

Jak szybko sprawdzić czy strona ma meta noindex?

Otwórz źródło strony i wyszukaj frazę meta name equals robots lub sprawdź nagłówki HTTP pod kątem X Robots Tag.

Czy CDN może blokować crawlerów?

Tak, błędna konfiguracja reguł geoblokowania lub list dostępu może odrzucać żądania robotów.

Co oznacza wiele 503 w logach crawlera?

503 wskazuje na tymczasowy problem serwera. Powtarzające się 503 mogą skutkować zmniejszeniem tempa crawlowania.

Jak rozpoznać czy kanonikalizacja ukrywa treść?

Sprawdź rel equals canonical na stronach i porównaj je z tym, co indeksuje wyszukiwarka. Jeśli wskazania są niezgodne, kanonikalizacja może wykluczać prawidłowe adresy.

Ile czasu zajmuje naprawa problemu z indeksacją?

To zależy od przyczyny. Proste zmiany w robots lub meta tagach są widoczne w ciągu dni. Poważniejsze problemy serwerowe mogą wymagać dłuższej naprawy i ponownych wizyt robota.

Czy JavaScript może ukryć treść przed robotami?

Tak. Jeśli kluczowa treść jest generowana po stronie klienta i nie renderuje się poprawnie podczas procesu renderowania robota, to będzie niewidoczna.